În 2022, producătorul american de cipuri Nvidia a lansat H100, unul dintre cele mai puternice procesoare pe care le-a construit vreodată – și unul dintre cele mai scumpe, costând aproximativ 40.000 de dolari fiecare. Lansarea a părut prost sincronizată, chiar în momentul în care întreprinderile căutau să reducă cheltuielile pe fondul unei inflații galopante.

Apoi, în noiembrie, a fost lansat ChatGPT.

„Am trecut de la un an destul de greu anul trecut la o răsturnare de situație peste noapte”, a declarat Jensen Huang, directorul executiv al Nvidia. Chatbotul de succes al OpenAI a fost un „moment aha”, a spus el. „A creat o cerere instantanee”.

Popularitatea bruscă a ChatGPT a declanșat o cursă a înarmării între cele mai importante companii de tehnologie din lume și start-up-uri care se grăbesc să obțină H100, pe care Huang îl descrie ca fiind „primul computer (cip) din lume conceput pentru AI generativă” – sisteme de inteligență artificială care pot crea rapid text, imagini și conținut asemănător cu cel uman.

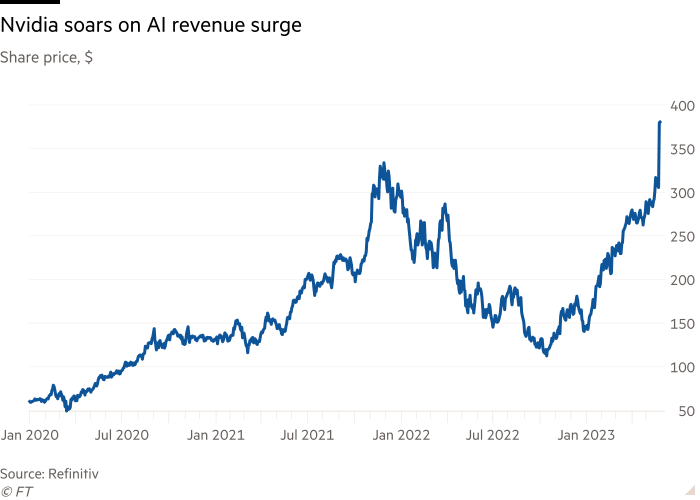

Valoarea de a avea produsul potrivit la momentul potrivit a devenit evidentă în această săptămână. Nvidia a anunțat miercuri că vânzările sale pentru cele trei luni care s-au încheiat în iulie vor fi de 11 miliarde de dolari, cu peste 50% mai mult decât estimările anterioare ale Wall Street, datorită unei revigorări a cheltuielilor pentru centrele de date de către Big Tech și a cererii pentru cipurile sale AI.

Răspunsul investitorilor la această prognoză a adăugat 184 miliarde de dolari la capitalizarea bursieră a Nvidia într-o singură zi, joi, ducând ceea ce era deja cea mai valoroasă companie de cipuri din lume aproape de o evaluare de 1 mld. dolari.

Nvidia este un câștigător timpuriu al creșterii astronomice a IA generativă, o tehnologie care amenință să remodeleze industriile, să producă câștiguri uriașe de productivitate și să înlocuiască milioane de locuri de muncă.

Acest salt tehnologic va fi accelerat de H100, care se bazează pe o nouă arhitectură de cipuri Nvidia denumită „Hopper” – după numele pionierului american al programării Grace Hopper – și care a devenit brusc cea mai populară marfă din Silicon Valley.

„Toată chestia asta a decolat chiar în momentul în care intrăm în producție pe Hopper”, a declarat Huang, adăugând că producția la scară a început cu doar câteva săptămâni înainte de debutul ChatGPT.

Încrederea lui Huang privind câștigurile continue provine în parte din faptul că a putut lucra cu producătorul de cipuri TSMC pentru a mări producția H100 pentru a satisface cererea explozivă din partea furnizorilor de cloud precum Microsoft, Amazon și Google, a grupurilor de internet precum Meta și a clienților corporativi.

„Aceasta se numără printre cele mai rare resurse de inginerie de pe planetă”, a declarat Brannin McBee, director de strategie și fondator al CoreWeave, un start-up de infrastructură cloud axat pe inteligență artificială care a fost unul dintre primii care a primit livrări de H100 la începutul acestui an.

Unii clienți au așteptat până la șase luni pentru a intra în posesia miilor de cipuri H100 pe care le doresc pentru a-și antrena modelele vaste de date. Start-up-urile de inteligență artificială și-au exprimat îngrijorarea cu privire la faptul că H100-urile vor fi în criză de aprovizionare chiar în momentul în care cererea a luat avânt.

Vedeți un instantaneu al unui grafic interactiv. Acest lucru se datorează cel mai probabil faptului că sunteți offline sau că JavaScript este dezactivat în browserul dvs.

Elon Musk, care a cumpărat mii de cipuri Nvidia pentru noul său start-up de inteligență artificială X.ai, a declarat în această săptămână la un eveniment Wall Street Journal că, în prezent, GPU-urile (unități de procesare grafică) „sunt considerabil mai greu de obținut decât drogurile”, glumind că nu era „o ștachetă prea înaltă în San Francisco”.

„Costul de calcul a devenit astronomic”, a adăugat Musk. „Miza minimă trebuie să fie de 250 de milioane de dolari pentru hardware de server (pentru a construi sisteme generative de inteligență artificială)”.

H100 se dovedește a fi deosebit de popular printre companiile Big Tech, cum ar fi Microsoft și Amazon, care construiesc centre de date întregi centrate pe sarcini de lucru AI, și start-up-uri de AI generativă, cum ar fi OpenAI, Anthropic, Stability AI și Inflection AI, deoarece promite performanțe mai mari care pot accelera lansarea de produse sau pot reduce costurile de instruire în timp.

„În ceea ce privește obținerea accesului, da, aceasta este ceea ce se simte ramping o nouă arhitectură GPU „, a declarat Ian Buck, șeful diviziei de calcul de înaltă performanță și hyperscale a Nvidia, care are sarcina dificilă de a crește oferta de H100 pentru a satisface cererea. „Se întâmplă la scară foarte mare”, a adăugat el, unii clienți mari căutând zeci de mii de GPU-uri.

Cipul neobișnuit de mare, un „accelerator” conceput pentru a funcționa în centrele de date, are 80 de miliarde de tranzistori, de cinci ori mai mulți decât procesoarele care alimentează cele mai recente iPhone-uri. Deși este de două ori mai scump decât predecesorul său, A100 lansat în 2020, primii utilizatori spun că H100 se mândrește cu performanțe de cel puțin trei ori mai bune.

„H100 rezolvă problema scalabilității care a chinuit creatorii de modele (AI)”, a declarat Emad Mostaque, cofondator și director executiv al Stability AI, una dintre companiile din spatele serviciului de generare a imaginilor Stable Diffusion. „Acest lucru este important, deoarece ne permite tuturor să antrenăm mai repede modele mai mari, pe măsură ce aceasta trece de la o problemă de cercetare la una de inginerie”.

În timp ce momentul lansării H100 a fost ideal, descoperirea Nvidia în domeniul IA poate fi urmărită cu aproape două decenii în urmă, datorită unei inovații în software mai degrabă decât în siliciu.

Software-ul său Cuda, creat în 2006, permite ca GPU-urile să fie reproiectate ca acceleratoare pentru alte tipuri de sarcini de lucru, dincolo de cele grafice. Apoi, în jurul anului 2012, a explicat Buck, „AI ne-a găsit”.

Cercetătorii din Canada și-au dat seama că GPU-urile erau ideale pentru a crea rețele neuronale, o formă de inteligență artificială inspirată de modul în care neuronii interacționează în creierul uman, care devenea atunci un nou punct de interes pentru dezvoltarea inteligenței artificiale. „A fost nevoie de aproape 20 de ani pentru a ajunge unde suntem astăzi”, a spus Buck.

Nvidia are acum mai mulți ingineri de software decât ingineri de hardware, pentru a-i permite să susțină numeroasele tipuri diferite de cadre de inteligență artificială care au apărut în anii următori și pentru a face cipurile sale mai eficiente în ceea ce privește calculul statistic necesar pentru a antrena modelele de inteligență artificială.

Hopper a fost prima arhitectură optimizată pentru „transformatoare”, abordarea inteligenței artificiale care stă la baza chatbot-ului „transformator generativ preformat” al OpenAI. Colaborarea strânsă a Nvidia cu cercetătorii în domeniul IA i-a permis să detecteze apariția transformatorului în 2017 și să înceapă să își ajusteze software-ul în consecință.

„Nvidia a văzut probabil viitorul înaintea tuturor celorlalți cu pivotul lor în a face GPU programabile”, a declarat Nathan Benaich, partener general la Air Street Capital, un investitor în start-up-uri de AI. „A detectat o oportunitate și a pariat mult și și-a depășit în mod constant concurenții.”

Benaich estimează că Nvidia are un avans de doi ani față de rivalii săi, dar adaugă: „Poziția sa este departe de a fi inatacabilă atât pe partea de hardware, cât și pe partea de software.”

Mostaque de la Stability AI este de acord. „Cipurile de generație următoare de la Google, Intel și alții recuperează din urmă (și) chiar și Cuda devine mai puțin un șanț pe măsură ce software-ul este standardizat.”

Pentru unii din industria IA, entuziasmul Wall Street din această săptămână pare prea optimist. Cu toate acestea, „deocamdată”, a declarat Jay Goldberg, fondatorul companiei de consultanță în domeniul cipurilor D2D Advisory, „piața IA pentru semicercuri pare să rămână o piață în care Nvidia va câștiga totul.”

Sursa – www.ft.com